Trí tuệ nhân tạo (AI) đang phát triển năng động và là tương lai của y học. Tuy nhiên, vẫn còn thiếu các quy định ở cấp độ quốc tế - đặc biệt là định nghĩa pháp lý - xác định trí tuệ nhân tạo và do đó, sự rõ ràng về vấn đề trách nhiệm đối với các lỗi y tế có thể xảy ra khi sử dụng thiết bị hỗ trợ AI.

Tiềm năng của AI trong y học

Các công cụ chẩn đoán được hỗ trợ bởi trí tuệ nhân tạo làm tăng chất lượng và hiệu quả của việc chăm sóc sức khỏe. Chúng được sử dụng chủ yếu để phỏng vấn bệnh nhân, phân tích kết quả xét nghiệm, theo dõi tình trạng của người được điều trị và thực hiện nhiều hoạt động khác của bác sĩ để đưa ra chẩn đoán thích hợp. Hoạt động bình thường của chúng chủ yếu phụ thuộc vào một lượng lớn thông tin đa dạng, bao gồm cả dữ liệu cụ thể về bệnh nhân.

- Việc truy cập không được kiểm soát vào những thông tin đó có thể dẫn đến nguy hại cho lợi ích cá nhân của cá nhân. Các trung tâm cung cấp dịch vụ chăm sóc sức khỏe tư nhân, không muốn chia sẻ nguồn thông tin bệnh nhân của họ - Konrad Jagocha, Cộng sự, Kancelaria Prawna Chałas i Wspólnicy, nghi ngờ về việc tích lũy dữ liệu.

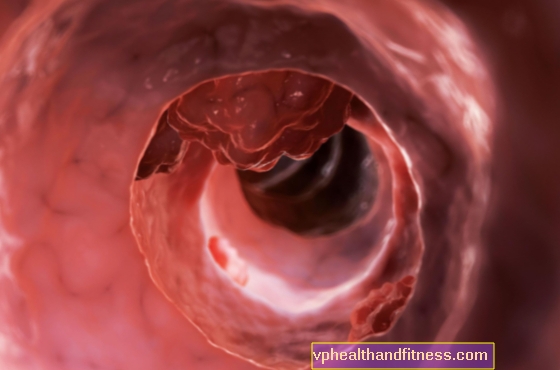

Một số hệ thống AI đã được sử dụng trong y học. Một trong số đó là DXplain - một chương trình sau khi phân tích tập hợp các triệu chứng được quan sát thấy ở một bệnh nhân, đưa ra danh sách các chẩn đoán có thể xảy ra. Tuy nhiên, anh ấy để lại sự lựa chọn cuối cùng cho bác sĩ. Germwatcher cũng rất đáng chú ý. Nó là một hệ thống thông tin trong phòng thí nghiệm phát hiện, theo dõi và kiểm tra khả năng nhiễm trùng ở những người nhập viện.

Sự ra đời của các hệ thống phẫu thuật bằng robot chắc chắn là một bước đột phá. Sử dụng hệ thống DaVinci với cánh tay robot, chuyển động chính xác và tầm nhìn từ tính, các bác sĩ lâm sàng có thể thực hiện các ca phẫu thuật mà các quy trình tiêu chuẩn không thể thực hiện được.

Cần quy định

Nghị viện Châu Âu cùng với Ủy ban Kinh tế và Xã hội Châu Âu chỉ ra rằng cần phải đưa ra một định nghĩa chính xác về trí tuệ nhân tạo. Nó phải đáp ứng các yêu cầu về tính nghiêm ngặt cao và do đó không tạo ra thêm những mơ hồ, nghi ngờ hoặc lỗ hổng pháp lý và đủ "mở" về mặt công nghệ để không kìm hãm sự phát triển tiềm năng của công nghệ AI trong tương lai.

Định nghĩa về AI hợp pháp sẽ cho phép chúng tôi xác định ai chịu trách nhiệm cho bất kỳ lỗi y tế nào phát sinh khi sử dụng các máy móc có sự hỗ trợ của AI.

- Theo quy định của pháp luật dân sự, để có thể giao trách nhiệm cho một chủ thể nhất định, cần phải có một trong những tiền đề, một mối liên hệ nhân quả đầy đủ giữa hành động hoặc sự thiếu sót của anh ta và sự kiện do thiệt hại xảy ra. Có vẻ như rất khó để gán trách nhiệm dân sự cho một thực thể đối với một hoạt động phát sinh từ trí tuệ nhân tạo. Người thầy thuốc không thể đoán trước ý định của cá nhân tự chủ. Đây là một vấn đề được đặc biệt chú ý bởi những người phản đối việc sử dụng AI trong y học - Konrad Jagocha, Associate, Kancelaria Prawna Chałas i Wspólnicy.

Cũng cần lưu ý rằng việc phát triển chẩn đoán bằng máy móc với nguồn trí tuệ nhân tạo có hiệu quả và nhanh hơn so với bác sĩ về mặt thống kê. Tuy nhiên, các chuyên gia nhấn mạnh rằng AI trong y học cần được con người giám sát liên tục do tầm quan trọng của những tác động mà bất kỳ sự gián đoạn nào có thể có. Ví dụ, đây là tinh thần của Cục Quản lý Thực phẩm và Dược phẩm Hoa Kỳ (FDA), cho phép các bác sĩ chỉ tiến hành nghiên cứu AI có nguy cơ thấp.

.jpg)

---na-czym-polega-ten-rytua.jpg)